العميد م. ناجي ملاعب

في وقت تقود الهمجية الإسرائيلية عمليتها الإنتقامية في قطاع غزة وباقي مدن الضفة الغربية المحتلة، وبالإعتماد على إحدى أهم تطبيقات تكنولوجيا التعرف على الوجوه، نصبت القوات المحتلة الي اقتحم مشفى الشفاء في مدينة غ-زة على مخرج إلزامي للمشفى، كاميراتها لمطابقة صور الخارجين منها مع مخزونها من صور المطلوبين لديها لإلقاء القبض عليهم بحجة انتمائهم الى منظمة حم-اس.

سأحاول في هذه المقالة الإضاءة على الإستخدام الشرطي لتقنية مطابقة الوجوه المعتمدة في الولايات المتحدة الأميركية ومدى نجاحها من خلال بعض التقارير الموثوقة، للإجابة حول إمكانية الوثوق بها كدليل أم أنها تقنية مساعدة.

ففي عام 2016، نشر مركز الخصوصية والتكنولوجيا، التابع لمركز القانون بجامعة جورج تاون، تقريرًا بعنوان “The Perpetual Line-Up”، والذي قدر أن وجوه مائة وسبعة عشر مليون أمريكي كانت موجودة في قواعد بيانات التعرف على الوجه على مستوى الولاية، يمكن لوكالات إنفاذ القانون الوصول إليها. العديد من هذه الصور جاءت من مصادر حكومية – صور رخصة القيادة، ولقطات، وما شابه. وجاءت صور أخرى من مصادر مثل كاميرات المراقبة ووسائل التواصل الاجتماعي.

شركات التكنولوجيا بتصرف الشرطة

في السنوات التي تلت نشر التقرير، أصبحت التكنولوجيا أكثر انتشارًا في كل مكان، لأسباب ليس أقلها أن بيعها أصبح عملاً مربحًا، كما أن الذكاء الاصطناعي أصبح أكثر انتشارًا. نجحت الشركات في إقناع وكالات إنفاذ القانون بأن تصبح عملاء لها. وجد تحقيق أجرته Buzz Feed News عام 2021 أن الموظفين في ما يقرب من ألفي وكالة عامة استخدموا أو اختبروا البرامج التي طورتها شركة الذكاء الإصطناعي Clearview AI، وهي شركة للتعرف على الوجه ولديها قاعدة بيانات تحتوي على مليارات الصور التي تم حذفها من الإنترنت. وقد قامت الشركة بتسويق خدماتها للشرطة من خلال الوعد بأن برمجياتها “دقيقة بنسبة 100% في جميع المجموعات السكانية”.

وينظر المؤيدون إلى تكنولوجيا التعرف على الوجه باعتبارها أداة لا تقدر بثمن يمكنها أن تساعد في جعل عمل الشرطة أكثر كفاءة وضمان محاسبة المجرمين. تلقت سمعة هذه التكنولوجيا دفعة كبيرة بعد أن ساعدت المحققين في التعرف على العديد من مثيري الشغب الذين اقتحموا مبنى الكابيتول الأمريكي في 6 كانون الثاني 2021. وفق ما نشر في كتاب جديد بعنوان “وجهك ينتمي إلينا”، يتتبع تاريخ تكنولوجيا التعرف على الوجه.

المساوئ

ليس من الصعب أن نتخيل السبب وراء رغبة المسؤولين عن إنفاذ القانون في الحصول على أداة قادرة على القيام بمثل هذه الأعمال البطولية. ومع ذلك، يخشى المنتقدون من أن تستخدم الشرطة تقنية التعرف الآلي على الوجوه لأغراض أكثر مرفوضة، مثل مراقبة أنشطة المتظاهرين السلميين والتعدي على خصوصية المواطنين. وتظل الأسئلة قائمة حول مدى موثوقية الأداة. مثل جميع أنظمة التعلم الآلي، تقوم برامج التعرف على الوجه بإجراء التنبؤات من خلال تمييز الأنماط في كميات كبيرة من البيانات. ويتم هذا التحليل غالبًا باستخدام الشبكات العصبية الاصطناعية، التي تحاكي وظيفة الدماغ البشري.

يتم تدريب التكنولوجيا باستخدام صور الوجوه، تمامًا كما يتم تدريب ChatGPT باستخدام النص، وبناء نموذج إحصائي يمكنه تعيين درجة ثقة للإشارة إلى مدى تشابه الصورتين. لكن حتى درجة الثقة التي تبلغ تسعة وتسعين بالمائة ليست مضمونة. وتعترف الشركات التي تسوق مثل هذه التكنولوجيا بأن النتيجة تعكس “أفضل تخمين خوارزمي” – وهو تخمين قد تختلف دقته تبعا لجودة الصورة الفوتوغرافية التي يلتقطها المسبار، والتي يمكن أن تتأثر بعوامل مثل الإضاءة وزاوية الكاميرا.

علاوة على ذلك، إذا كانت مجموعة البيانات المستخدمة لتدريب الخوارزمية غير متوازنة – وجوه الذكور أكثر من وجوه الإناث، أو الوجوه البيضاء أكثر من وجوه السود – فقد يكون أداء النموذج أسوأ بالنسبة لبعض المجموعات الديموغرافية. يقول جوناثان فرانكل، المتخصص في الشبكات العصبية والذي أجرى أبحاثًا في تكنولوجيا التعرف على الوجه: “كما هو الحال مع كل الأشياء في مجال التعلم الآلي، فأنت جيد بقدر بياناتك فقط. إذا كانت بيانات التدريب الخاصة بي تمثل مجموعة معينة بشكل كبير، فمن المرجح أن يكون نموذجي أكثر موثوقية في تقييم أعضاء تلك المجموعة، لأن هذا هو ما رآه.

الإعتقال الكاذب

في عام 2019، نشر المعهد الوطني للمعايير والتكنولوجيا، وهو وكالة اتحادية أميركية، دراسة كشفت أن العديد من أنظمة التعرف على الوجه حددت بشكل خاطئ الوجوه السوداء والآسيوية بمعدل يتراوح بين عشر إلى مائة مرة أكثر من الوجوه القوقازية. وكانت الأخطاء أيضًا أكثر شيوعًا عند النساء وكبار السن.

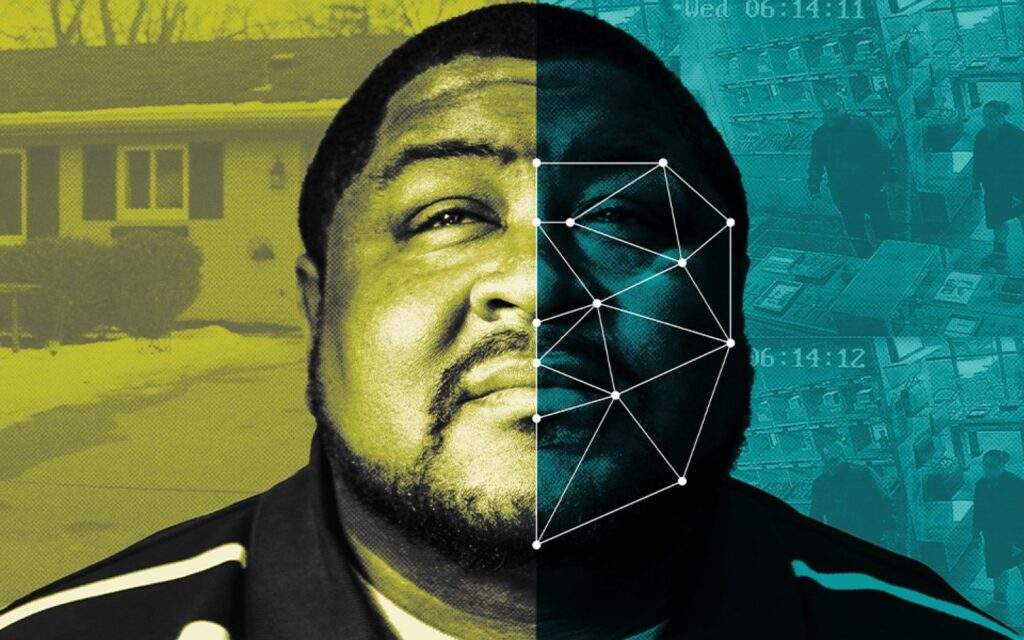

وفي حادثة أخطأ فيها رجال الشرطة بالإعتقال اعتماداً على تقنية صورة الوجه، في كانون الثاني من عام 2020 تم القبض على أحد سكان ميشيغان، ويُدعى روبرت ويليامز، أمام زوجته وأطفاله، بناءً على صورة مستخرجة من لقطات المراقبة، بزعم سرقة ساعات من متجر في ديترويت. تم التعرف عليه على أنه شخص محل اهتمام. لم يرتكب ويليامز الجريمة، كما أدركت الشرطة عندما رفعت صورة السارق بجوار وجهه. ومن بين أمور أخرى، كان ويليامز أكبر حجمًا من اللص وكان له وجه أوسع. كانت محنته، التي رويت لاحقًا في صحيفة التايمز، أول مثال معروف علنًا لقضية لعبت فيها تقنية التعرف على الوجه دورًا بارزًا في الاعتقال الكاذب. وقد تم توثيق خمس حالات مماثلة منذ ذلك الحين. وفي جميع هذه الحالات، كان المشتبه به الذي تم احتجازه عن طريق الخطأ أسود اللون، مما يثير المخاوف من أن الخوارزميات تميز بشكل أقل دقة وجوه الأشخاص ذوي البشرة الداكنة، مما يعزز التفاوتات العرقية في نظام العدالة الجنائية.

نسبة الخطأ

ويعترف المدافعون عن تكنولوجيا التعرف على الوجه بأن جودة الخوارزميات تتباين بشكل كبير، لكنهم يؤكدون أن أفضلها لا تعاني من مثل هذا الاختلال في التوازن الديموغرافي. ويشيرون أيضًا إلى أنه من بين ملايين عمليات التفتيش التي أجرتها الشرطة، ثبت أن عددًا قليلًا منها فقط أدى إلى اعتقالات غير مشروعة. ولكن كم عدد الأشخاص الذين تم التعرف عليهم عن طريق الخطأ من دون أن يتم التعرف على الخطأ؟ لا أحد يستطيع أن يقول ذلك، ويرجع ذلك جزئيًا إلى أن هذه التكنولوجيا سيئة التنظيم، كما أن استخدام الشرطة لها غالبًا لا يتم تقاسمه مع الجمهور أو المتهم.

يعترف المدافعون عن تكنولوجيا التعرف على الوجه بأن جودة الخوارزميات تتباين بشكل كبير، لكنهم يؤكدون أن أفضلها لا تعاني من مثل هذا الاختلال في التوازن الديموغرافي.

هناك عامل آخر يمكن أن يزيد من خطر الأخطاء وهو “التأثير عبر الأعراق”: ميل البشر إلى مواجهة صعوبة في التعرف على وجوه الأشخاص من عرق أو إثنية مختلفة. وجدت مراجعة لأربعة عشر دراسة تجريبية أن حوالي ثمانين بالمائة من الأشخاص البيض والسود كانوا أفضل في تمييز الوجوه من عرقهم. “إذا كان محلل التعرف على الوجوه أبيض اللون وكان موضوع البحث سيتم استهداف أفراد المجتمع المهمشين بالفعل”.

ويجادل المسؤولون عن إنفاذ القانون بأنهم غير ملزمين بالكشف عن مثل هذه المعلومات، لأنه من الناحية النظرية على الأقل، تُستخدم عمليات البحث بالتعرف على الوجه فقط لتوليد خيوط لإجراء تحقيق أكمل، ولا تعمل وحدها كسبب محتمل لإجراء اعتقال. ومع ذلك، في عدد مذهل من حالات الاعتقال غير المشروعة التي تم توثيقها، كانت عمليات التفتيش تمثل التحقيق بأكمله تقريبًا.

الحكم البشري الشخصي

في تقرير نُشر العام الماضي، تبين لمحققي الشرطة إن العصمة المفترضة للتكنولوجيا تخاطر بحجب حقيقة مفادها أن التعرف على الوجه، في سياق التحقيقات الجنائية هو أداة تعتمد بشكل كبير على الحكم البشري الشخصي. لا يُنتج البحث النموذجي وجهًا واحدًا فقط، بل يُنتج “قائمة مرشحين” تضم العشرات، وأحيانًا المئات، من التطابقات المحتملة. وبعبارة أخرى، فإن معظم العائدات هي نتائج إيجابية كاذبة. إن مهمة مراجعة القائمة وتحديد أي مرشح، إن وجد، قد يكون مطابقًا صحيحًا لا تقع على عاتق الخوارزمية، بل على عاتق شخص ما – ممثل عن إنفاذ القانون قد تكون مؤهلاته في هذا المجال محدودة. وخلص تقرير نشره مكتب المحاسبة الحكومية في أيلول 2023 إلى أن سبع وكالات لإنفاذ القانون في وزارة الأمن الداخلي ووزارة العدل سمحت في البداية للموظفين باستخدام تكنولوجيا التعرف على الوجه من دون أي تدريب، ماحدى بمكتب التحقيقات الفيدرالي الطلب من بعض العملاء أن يتابعوا دورات متخصصة لتوثيق معرفتهم بالتقنية الجديدة

في مقال مراجعة للقانون لعام 2021، قالت لورا موي، مديرة عيادة قانون الاتصالات والتكنولوجيا في جامعة جورج تاون، إن الاعتماد المتزايد على التعرف الآلي على الوجوه يمكن أن يؤدي إلى المزيد من الإدانات الخاطئة من خلال إزاحة تقنيات التحقيق التقليدية، مثل فحص الأصوات في الحي سيرا على الأقدام وإجراء مقابلات مع أكبر عدد ممكن من الناس. وأشارت موي إلى أن هذه الأساليب قد تتطلب المزيد من الوقت والموارد، لكنها قد تكشف خيوطًا زائفة.

أي دور لتقنية ChatGPT

قد يشعر مهندسو البرمجيات المطلعون على مدى سرعة تقدم الذكاء الاصطناعي أنه مع تحسن التكنولوجيا وزيادة دقة الخوارزميات، فإن مثل هذه القيود ستكون غير ضرورية. جوناثان فرانكل، المتخصص في الشبكات العصبية، لا يتفق مع هذا الرأي، فقد أشار إلى “أن ChatGPT لا يتم تدريبه على اتخاذ قرارات بشأن حياة الناس وحريتهم”. “المخاطر هنا أكبر بكثير.” وقد أكدت الدراسات الآن أن الخطر واضح بشكل خاص بالنسبة لأفراد مجتمعات معينة.

بينما قال تاوانا بيتي، منظم العدالة الاجتماعية في ديترويت: “سيتم استهداف أفراد المجتمع المهمشين بالفعل”. ففي عام 2016، أطلقت شرطة ديترويت مشروع الضوء الأخضر، وهي مبادرة لمكافحة الجريمة وضعت كاميرات مراقبة في محطات الوقود في أحياء المدينة الداخلية. وقال بيتي إن المشروع “تم تقديمه إلينا باعتباره أمانًا”. ومنذ ذلك الحين، تم القبض على ثلاثة أشخاص سود على الأقل في ديترويت بشكل خاطئ، بما في ذلك، مؤخرًا، امرأة تدعى بورشا وودروف، التي كانت حاملاً في شهرها الثامن في ذلك الوقت.

المحكمة ووسائل الإثبات

إذا كانت مقارنة وتحديد الوجوه غير المألوفة من المهام التي يمكن للبشر إتقانها بسهولة، فقد لا يكون الافتقار إلى التدريب مدعاة للقلق. ولكن في إحدى الدراسات التي طُلب فيها من المشاركين تحديد هوية شخص ما من مجموعة صور فوتوغرافية للمشتبه بهم، كان معدل الخطأ مرتفعًا بنسبة ثلاثين بالمائة. واستخدمت الدراسة بشكل أساسي صورًا عالية الجودة لأشخاص في أوضاع واضحة – وهو ترف لا يتمتع به عادةً وكلاء إنفاذ القانون الذين يفحصون الصور المستخرجة من فيديو المراقبة المحبب.

وقد أدت الدراسات التي تستخدم صورًا منخفضة الجودة إلى ارتفاع معدلات الخطأ. قد تفترض أن المتخصصين ذوي الخبرة في إجراء فحوصات الطب الشرعي للوجه سيكونون أقل عرضة للخطأ في التعرف على شخص ما، ولكن هذا ليس هو الحال.

وهنا يأتي دور المحكمة في ضرورة تبيان وسائل الإثبات، فقد أمرت محكمة الاستئناف شرطة نيويورك بتسليم معلومات مفصلة حول بحث التعرف على الوجه الذي أدى إلى اتهام أحد سكان كوينز يُدعى فرانسيسكو أرتيجا بسرقة متجر. طلبت المحكمة الكود المصدري للبرنامج المستخدم ومعلومات حول الخوارزمية الخاصة به. ولأن التكنولوجيا كانت “جديدة وغير مختبرة”، رأت المحكمة أن حرمان المتهمين من الوصول إلى مثل هذه المعلومات يهدد بانتهاك قاعدة برادي، التي تتطلب من المدعين الكشف عن جميع أدلة البراءة المحتملة للمشتبه بهم الذين يواجهون اتهامات جنائية. ومن بين الأشياء التي قد يرغب المدعى عليه في معرفتها ما إذا كانت الصورة التي تم استخدامها في التفتيش الذي أدى إلى اعتقاله قد تم تعديلها رقميًا. فيما تلاحظ شركة DataWorks Plus على موقعها على الويب أن الصور التي يتم إدخالها في برنامجها “يمكن تحريرها باستخدام تصحيح الوضع، وتطبيع الضوء، والتدوير، والاقتصاص” وتمكن بعض الأنظمة الشرطة من الجمع بين صورتين؛ ويتضمن البعض الآخر أدوات تصوير ثلاثية الأبعاد لإعادة بناء الميزات التي يصعب تحديدها.

في الخلاصة، فإن تقنية التعرف على الوجه تمثل تطوّراً هاماً في التقنيات الحديثة يمكن الإستفادة منها في كافة المجالات ولكن في تحقيقات الشرطة تبقى عاملاً مساعداً رغم نسبة نجاحها الفائقة لأن الشك دائماً يبقى لصالح المتهم.